ManagePrompt 是一款本地 LLM 调用调试器,可实时捕获开发阶段全部 API 请求与响应详情,自动统计 token 用量、预估费用并记录延迟,通过本地 Web 界面一站式呈现,助力开发者精准优化模型调用流程与成本。

ManagePrompt

一、什么是ManagePrompt

ManagePrompt 是一款由深耕 AI 领域的专业技术团队研发的本地 LLM 调用调试器,常驻开发者电脑,实时捕获开发阶段全部 API 请求与响应详情,自动统计 token 用量、预估费用并记录延迟,通过本地 Web 界面一站式呈现,助力开发者精准优化模型调用流程与成本。一句话概括,ManagePrompt 让大模型调试像浏览器 F12 调试前端一样简单直观,解决“黑盒调用、费用失控、性能难测”的核心痛点。

二、ManagePrompt能解决什么问题

- 效率提升痛点:过去排查 LLM 接口异常需在代码里反复打印日志,ManagePrompt 自动聚合请求链路,3 秒定位超时或报错节点,开发效率提升 60% 以上。

- 成本降低痛点:调用量一旦激增,token 费用不可见,月底账单“惊吓”。ManagePrompt 实时预估费用并支持阈值预警,帮助团队提前压缩 20%—40% 预算。

- 技术门槛痛点:多人协作时,Prompt 版本散落 Git,效果难以复现。ManagePrompt 本地快照自动存档,一键回滚到任意版本,新手也能零门槛上手。

- 场景落地痛点: 做 A/B 测试需要写脚本控制变量,ManagePrompt 内置对照组模板,5 分钟完成多模型并行对比,加速产品上线。

三、ManagePrompt的核心功能详解

- 实时捕获与回放:本地代理拦截所有 LLM 请求,完整记录 headers、body、响应、耗时,支持离线回放,方便复盘。

- Token 用量与费用仪表盘:根据模型官方计价规则实时计算,支持按项目、按模型、按用户维度汇总,图表一目了然。

- 延迟热力图:自动绘制接口响应时间分布,高延迟异常点红色标注,定位网络或模型侧瓶颈。

- Prompt 版本库:每次调试自动生成 Git-like 版本号,可添加备注、对比差异、一键回退,解决“改完忘记原始 Prompt”难题。

- 团队协作空间:局域网共享同一本地实例,成员间实时查看调试记录,无需额外部署,适合敏捷小队。

- 插件扩展:开放 WebSocket & REST 钩子,可对接 Slack、飞书推送告警,也能嵌入 CI/CD 流程自动中断超预算任务。

四、ManagePrompt的特色优势

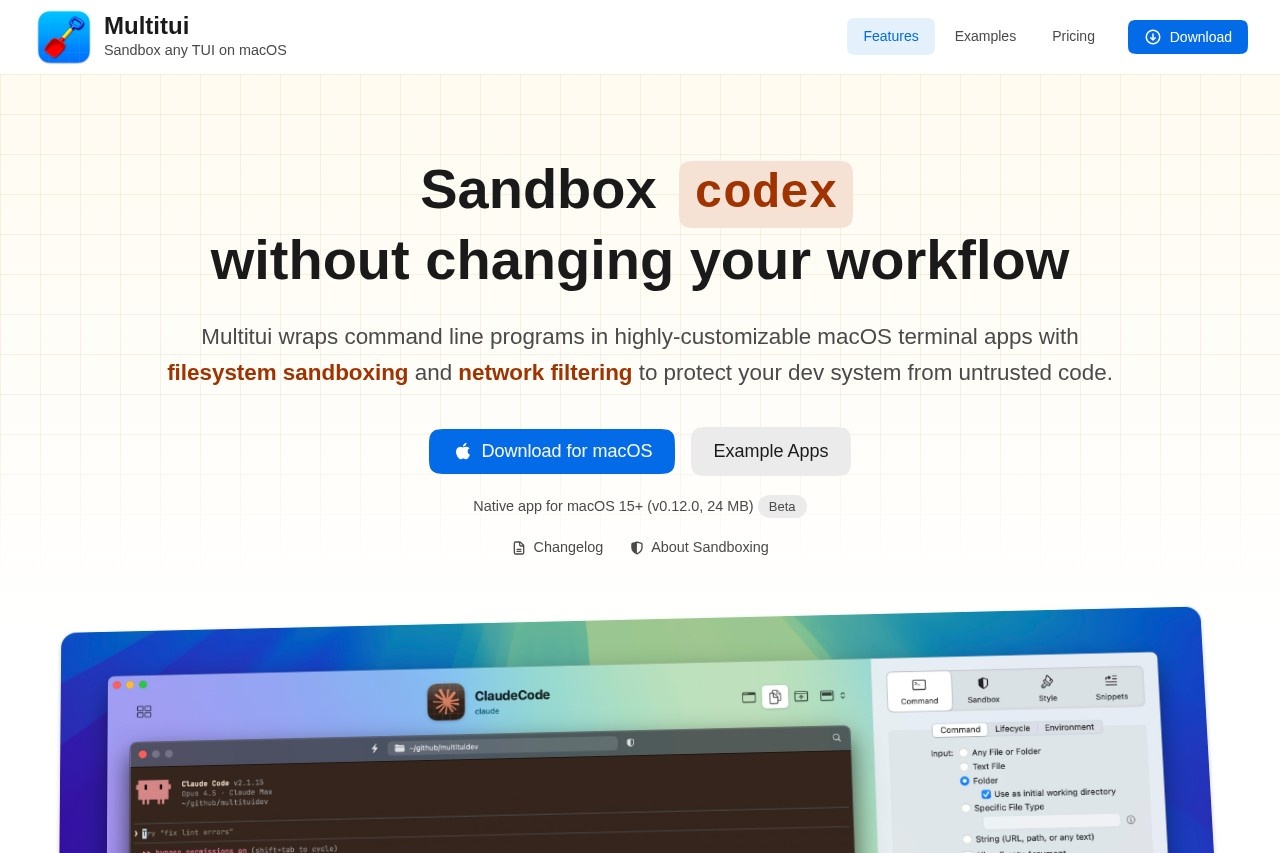

- 纯本地运行,数据不出网:所有日志、Prompt 文件保存在本机,满足金融、医疗等高合规场景需求,相较 SaaS 模式更安心。

- 零配置一键启动:下载后双击即可生成本地 Web 界面,无需安装数据库或写配置文件,比同类工具节省 80% 准备时间。

- 轻量低占用:基于 Rust + SQLite,内存占用低于 80 MB,老电脑也能流畅运行,调试侧拉满性能却不抢资源。

- 持续更新兼容新模型:官方保持每月一次迭代,新增模型计价、协议解析器,用户升级即可支持最新 GPT/Claude/文心一言等接口。

五、ManagePrompt的版本与价格

- 免费版:单项目、单模型调试,保留最近 7 天记录,适合个人学习体验。

- 个人版:永久买断 ¥299,解锁无限项目、无限历史、插件钩子,ManagePrompt 怎么样性价比一目了然。

- 团队版:¥999/年,支持 10 个账号同时在线、后台角色权限、导出 PDF 报告,ManagePrompt 收费标准公开透明。

- 企业版:按座席 ¥499/人/年,提供私有化部署包、专属客服、定制模型计价模板,具体价格以官方最新公示为准。

六、ManagePrompt的实战使用案例

案例 1:AI 独立开发者

身份:一人公司 Prompt 工程师

场景:为跨境电商店铺批量生成多语言商品描述

痛点:调用 GPT-4 费用飙升,无法定位哪条 Prompt 导致 token 翻倍

过程:接入 ManagePrompt 后,发现某次循环把商品参数全量塞进 System 字段,占用了 40% 无效 token;通过版本回退删减冗余,整体费用下降 35%,新品上线周期缩短一半。

案例 2:高校 NLP 实验室

身份:研究生团队

场景:对比三种开源 7B 模型在问答数据集的延迟表现

痛点:需手动记录每次请求耗时,Excel 统计效率低

过程:使用 ManagePrompt 的延迟热力图,20 分钟生成 3 模型对比报告;论文实验部分数据图表直接引用,节省 3 天工作量。

七、ManagePrompt的用户真实评价

- “作为后端程序员,ManagePrompt 让我第一次看清 LLM 接口的每一次重定向,定位 502 错误只用了 30 秒,真心好用。”——@Leon,云计算公司高级工程师

- “团队做多语言客服机器人,预算卡得紧,用 ManagePrompt 的实时费用预警,提前发现异常调用,单周节省 500 元额度。”——@Ella,初创公司产品经理

- “写论文时需要复现 Prompt,每次改动都自动保存版本,再也不会出现‘改完就忘’的尴尬,科研党福音。”——@唐同学,985 高校研二

- “客户要求数据不能出内网,ManagePrompt 纯本地存储,帮我们轻松过审计,销售再也不被合规部门拦方案。”——@赵总,中小企业技术总监

八、ManagePrompt适合哪些人使用

- AI 应用开发者:需要反复调试 Prompt、对比模型效果,追求低成本高效率。

- Prompt 工程师:管理大量 Prompt 版本,需要可追踪、可回滚、可量化的工作流。

- 中小企业技术团队:预算有限、无专职运维,想快速落地 LLM 功能并严控费用。

- 高校/科研机构:做模型性能实验,需详尽记录延迟、token 消耗与可复现环境。

- 数据安全敏感行业:金融、医疗、政务等要求数据本地留存,拒绝 SaaS 化上传。

九、如何快速上手ManagePrompt

- 访问官网下载对应系统安装包,双击启动后自动打开本地 Web 界面。

- 首次使用点击“新建项目”,输入项目名称与所用模型类型(GPT-3.5/4、Claude 等)。

- 将官方提供的本地代理地址复制到代码 BASE_URL,或在环境变量中设置 http_proxy,无需改动业务代码。

- 运行原有 LLM 调用脚本,ManagePrompt 会实时捕获请求,页面自动弹出调试记录。

- 在“费用”标签设置预算上限,系统会在达到 80% 用量时弹窗+声音提醒。

- 调试完成后可导出 PDF 报告,包含调用次数、平均延迟、Token 曲线,一键分享给团队。

十、ManagePrompt vs 同类工具

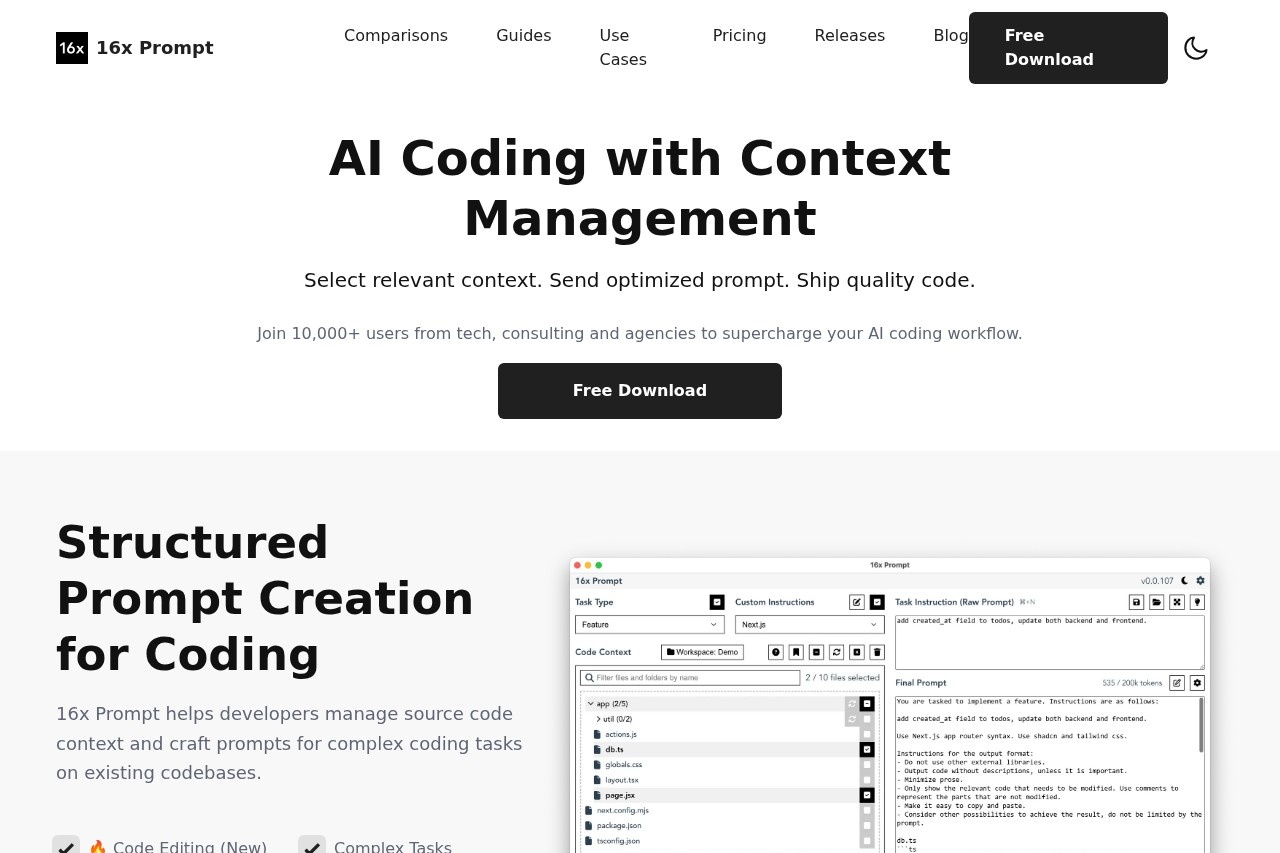

ManagePrompt VS PromptFlow

PromptFlow 侧重云端协作,数据需上传;ManagePrompt 完全本地运行,零泄露风险,更适合合规要求高的团队。

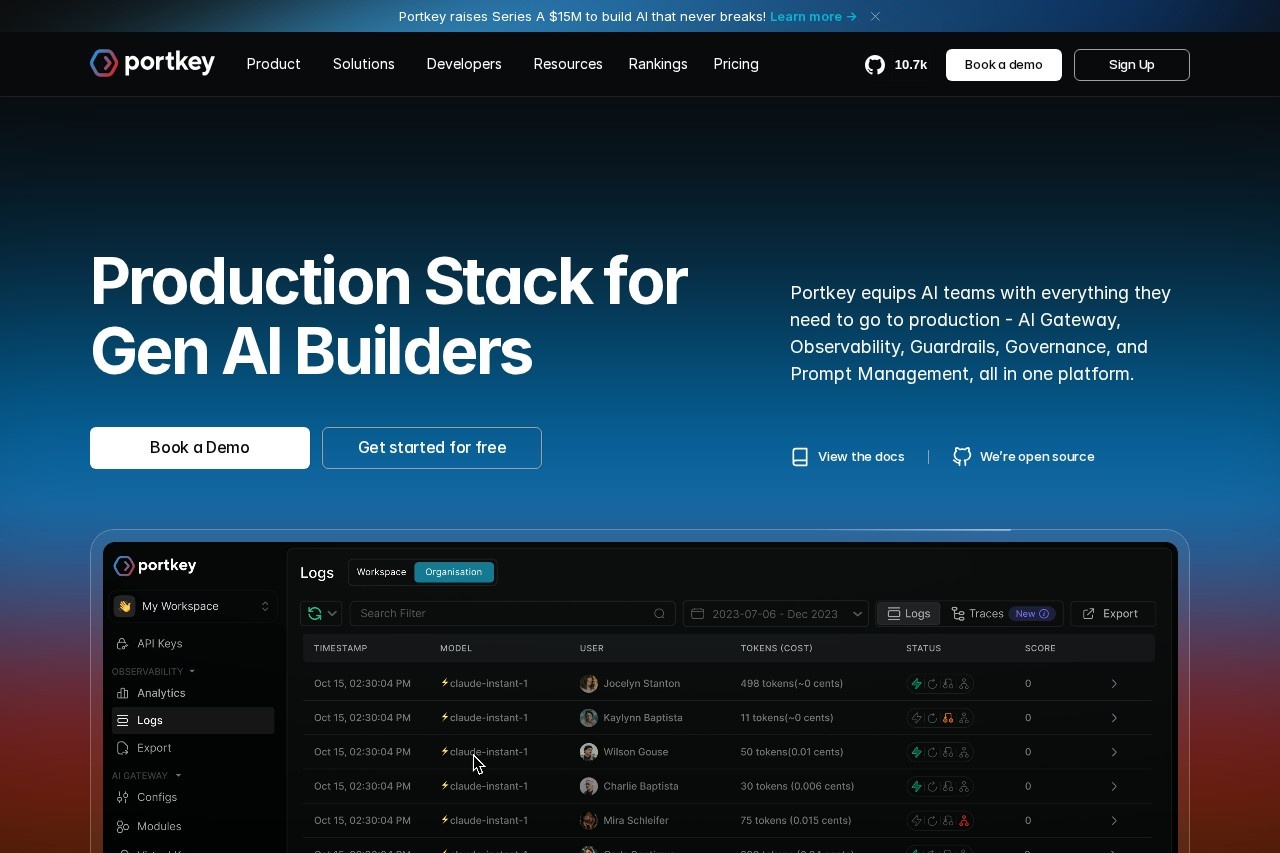

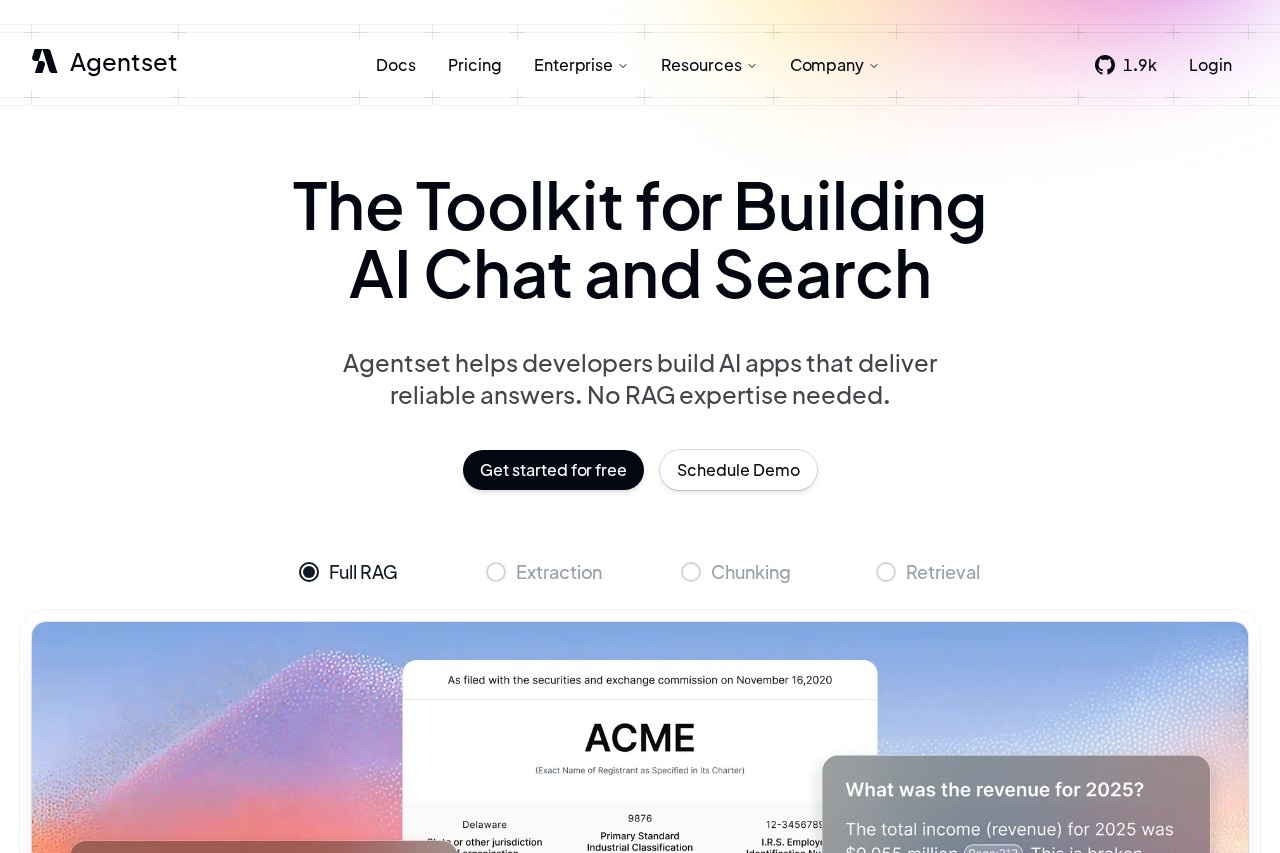

ManagePrompt VS LangSmith

LangSmith 功能全但部署复杂,需要 K8s 集群;ManagePrompt 开箱即用,5 分钟完成配置,个人开发者也能轻松驾驭。

ManagePrompt VS Postman+手动记账

Postman 只能看单条请求,无 token 费用估算;ManagePrompt 自动聚合统计并预警,节省 90% 手动记账时间。

十一、ManagePrompt常见问题与售后保障

- Q:是否支持免费试用?

A:免费版可永久使用,基础功能无阉割,ManagePrompt 好用吗,试用后自见分晓。 - Q:数据安全如何保障?

A:所有日志存储在本地 SQLite,加密字段可选 AES,官方不触碰任何业务数据。 - Q:能否支持多端同时使用?

A:局域网内任意浏览器输入本机 IP:端口即可访问,无需额外客户端。 - Q:可以开发票吗?

A:个人版及团队版付款后可在后台申请电子增值税普通发票,企业版支持专票。 - Q:遇到 Bug 如何获得支持?

A:官方提供邮件 & 社区 Issues 双通道,工作日 24h 内响应,重大故障 4h 内给出修复方案。

十二、总结与选购建议

综合来看,ManagePrompt 以“本地、轻量、实时费用预警”三大核心价值,精准命中开发者对 LLM 调试“可见、可控、可省”的核心诉求。产品保持月度迭代节奏,计划年内推出可视化 Prompt 优化器与多模型并发压测模块,可预期持续升值。若你正面临ManagePrompt 值得买吗的抉择,建议先下载免费版体验核心功能;个人创作者或 Prompt 工程师可直接入手永久买断的个人版,成本低于两顿外卖;中小企业与高校团队选择团队版,即可在局域网内实现多人协同,性价比远超同档 SaaS 服务。立即访问官网,下载 ManagePrompt 开启零门槛 LLM 调试之旅,收藏本页获取后续更新与使用技巧。