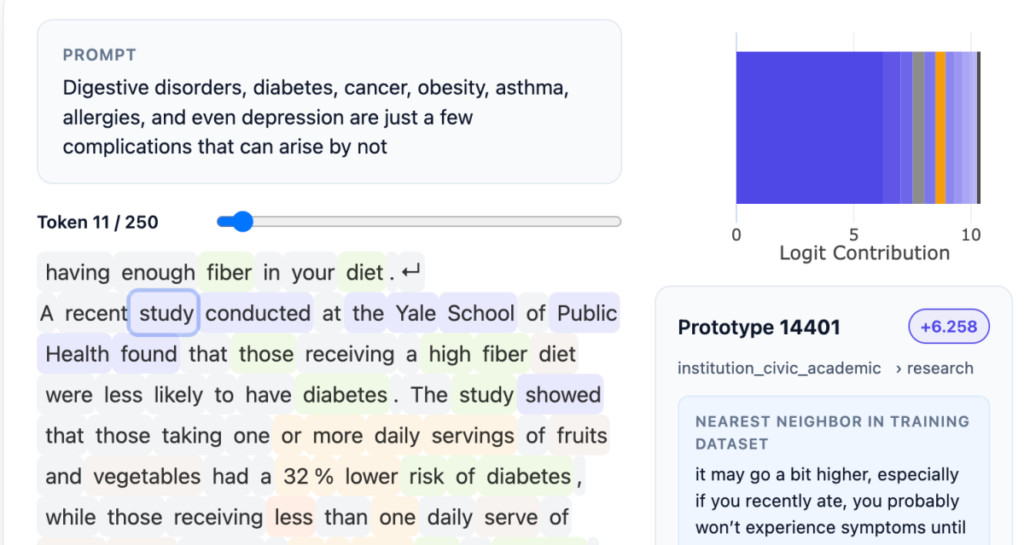

理解深度学习模型的行为动机一直是个挑战,无论是处理模型的政治倾向、奉承行为还是幻觉问题。旧金山初创公司Guide Labs为此提出了解决方案。该公司开源了一个拥有数十亿参数的大语言模型Steerling-8B,其采用的新型架构旨在使模型行为易于解释:模型生成的每个标记都能追溯至其训练数据中的起源。这既可以用于确定模型引用事实的参考来源,也能用于理解模型对幽默或性别等复杂概念的理解方式。

首席执行官Julius Adebayo在麻省理工学院攻读博士学位期间便开始了这项工作。他们开发了一种构建大语言模型的新方法:开发者在模型中插入一个概念层,将数据归类到可追踪的类别中。这种方法需要更多的前期数据标注,但通过借助其他AI模型的帮助,他们成功训练出了这个模型作为目前最大的概念验证。

这种方法的潜在担忧是,它可能会消除大语言模型一些令人着迷的涌现能力,即对未经训练的事物进行新颖概括的能力。Adebayo表示,这种现象在其公司的模型中仍然存在,他的团队会追踪模型自行发现的“被发现的概念”。

Adebayo认为,这种可解释的架构将成为每个人的需求。对于面向消费者的大语言模型,这些技术应能让模型构建者实现诸如阻止使用受版权保护材料,或更好地控制有关暴力或药物滥用等主题的输出。受监管的行业将需要更可控的大语言模型,例如在金融领域,评估贷款申请人的模型需要考虑财务记录而非种族等因素。科学工作同样需要可解释性。

Guide Labs表示,得益于其新颖的架构,Steerling-8B能够达到现有模型大部分的能力,但使用的训练数据更少。该公司的下一步是构建一个更大的模型,并开始向用户提供API和智能体访问服务。Adebayo强调,实现内在的可解释性民主化,对于人类种族而言将是一件长期的益事。