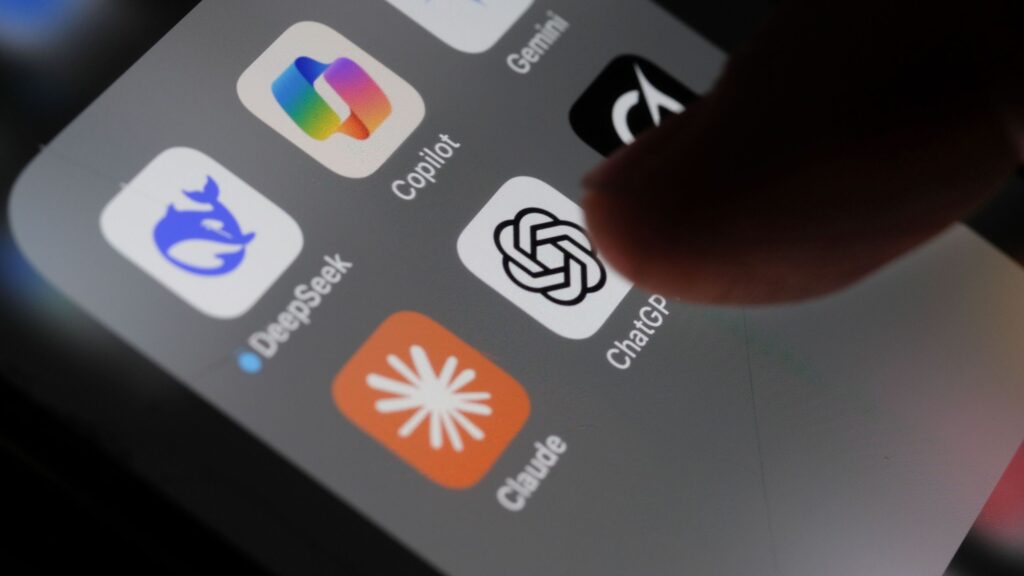

当前,越来越多的人开始转向如ChatGPT和Gemini等AI聊天机器人,以获取其原本并非设计用途的心理健康支持。一家自杀预防慈善机构的研究表明,相当比例的人群正在使用AI工具获取心理健康建议,其中年轻一代的使用率尤为突出。

AI的吸引力显而易见:它免费、即时且始终可用,没有等待名单、尴尬对话或成本障碍。然而,这种便利性掩盖了更复杂的现实。监管机构已敦促谨慎使用技术进行心理健康支持,而研究发现,许多人依赖的工具并未针对该角色进行设计、监管或临床验证。

更深层的问题在于可负担性。研究显示,人们为心理健康应用支付了巨额费用,部分人甚至为此在生活必需品上做出艰难取舍。这揭示了传统支持途径存在的高昂成本壁垒。

为此,该慈善机构推出了一个免费的、由专家支持的心理健康工具包应用,旨在提供支持,同时避免许多现有选项的风险与成本。与AI聊天机器人不同,该应用不试图模拟对话或即时生成回应,而是专注于由心理健康专业人士创建的循证技术,为压力、焦虑和情绪低落等问题提供结构化支持。

该应用旨在提供一种介于无所作为和需要危机干预之间的支持——一个用于心理健康“日常维护”的空间。机构负责人指出,围绕心理健康的对话正面临令人担忧的污名化加剧,人们显然需要在情绪爆发时需要可求助之处。

对于部分用户,聊天机器人可能感觉是一个安全、无评判的倾诉空间。但它们也存在众所周知的局限性,包括产生幻觉、缺乏临床监督以及可能提供误导或不恰当回应。

该慈善机构采取了更为谨慎的策略。其应用特意不假装是人类,虽然语言亲切易懂,但在心理健康领域,让技术模仿与人类的对话是他们无法从伦理上认可的。机构服务负责人明确表示,在自杀预防领域,使用AI聊天机器人是他们无法承担的风险。因此,该应用中的所有内容均由人类专家创建,目前未启用机器学习来定制用户体验,而是通过监测匿名用户行为及应用内活动反馈来进行优化。