Anthropic与美国国防部进行了为期数周的激烈谈判,这场博弈通过社交媒体、公开声明以及匿名官员向媒体的放话不断升级。谈判的核心争议点在于三个字:“任何合法用途”。据报道,OpenAI和xAI已同意此条款,该条款可能赋予美国军方广泛权力,将其AI服务用于大规模监控和致命自主武器系统,即无需人类决策即可追踪和消灭目标的AI。

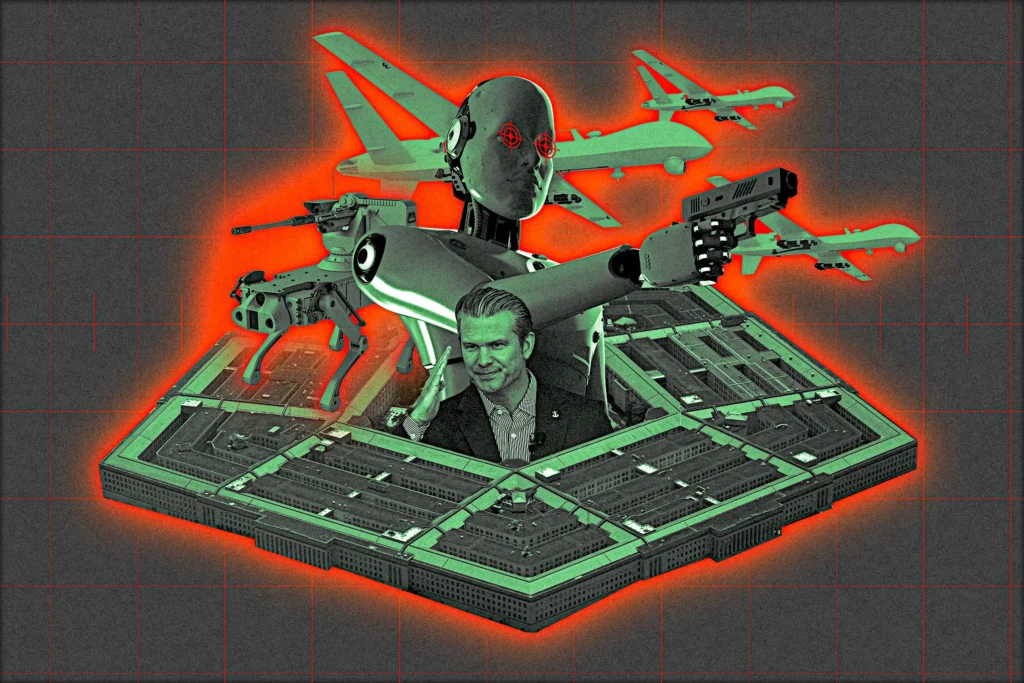

谈判已变得十分激烈。据知情人士透露,由前优步高管、五角大楼首席技术官埃米尔·迈克尔主导的政府方,威胁将Anthropic指定为“供应链风险”。这一分类通常用于涉及国家安全威胁的实体。Anthropic首席执行官达里奥·阿莫代预计将与国防部官员会面,有国防部官员将此会面描述为决定性的关键时刻。

五角大楼对美国公司发出此类威胁是前所未有的,而公开威胁则更为罕见。根据现行法规,国防部本可秘密将Anthropic列为风险而不公开说明。分析人士指出,此次特意公开标签其为国家安全风险,并试图阻止其他公司与Anthropic合作,其做法超出了常规。

冲突的根源在于Anthropic坚持执行其“可接受使用政策”。如果被正式列为供应链风险,不仅将终结其与五角大楼的巨额合同,更将对公司的整体运营造成毁灭性连锁反应。许多主要国防承包商和科技公司因其AI模型是首个获准处理机密信息的模型而在工作中使用Anthropic的Claude。若被贴上风险标签,任何与军方有业务往来或希望获得军事合同的公司都可能被迫放弃其AI系统。

分析指出,这项威胁的实施范围可窄可宽。一种较窄的解释是禁止Anthropic用于五角大楼的特定工作任务;但基于当前舆论态势,也存在实施广泛限制的可能性。尽管五角大楼及其媒体盟友试图给Anthropic贴上“觉醒”标签,但并未提出具体的安全漏洞或间谍指控。据熟悉内部讨论的人士称,冲突本质在于Anthropic对其使用政策的坚守。

有匿名消息人士透露,Anthropic已向政府明确划出红线,主要在两个方面绝不妥协:自主动能作战(即致命自主武器)和大规模国内监控。公司正为此核心原则进行一场生存谈判。