2026年AI工具箱完整版:最新功能、应用场景与下载指南

分类:AI动态 浏览量:659

过去两年,我试过把十几款 AI 工具拼成一条“生产线”:文生图跑在云端,语音识别挂在本地,中间还得自己写脚本做格式转换。每次演示前,我都要在心里默念三遍“别崩”。直到 2026 版 AI 工具箱递到我手里,我才第一次产生“要不把旧脚本全删了”的冲动。它把多模态大模型、零代码编排、边缘离线包一股脑塞进一个安装器,Windows、macOS、国产系统都能一键识别。这篇文章,我想把这段“踩坑—惊喜—再踩坑”的完整体验摊开给你看:它到底新在哪、能干什么、装起来麻烦不麻烦,以及——最关键——值不值得你立刻升级。

2026年AI工具箱概览

什么是AI工具箱

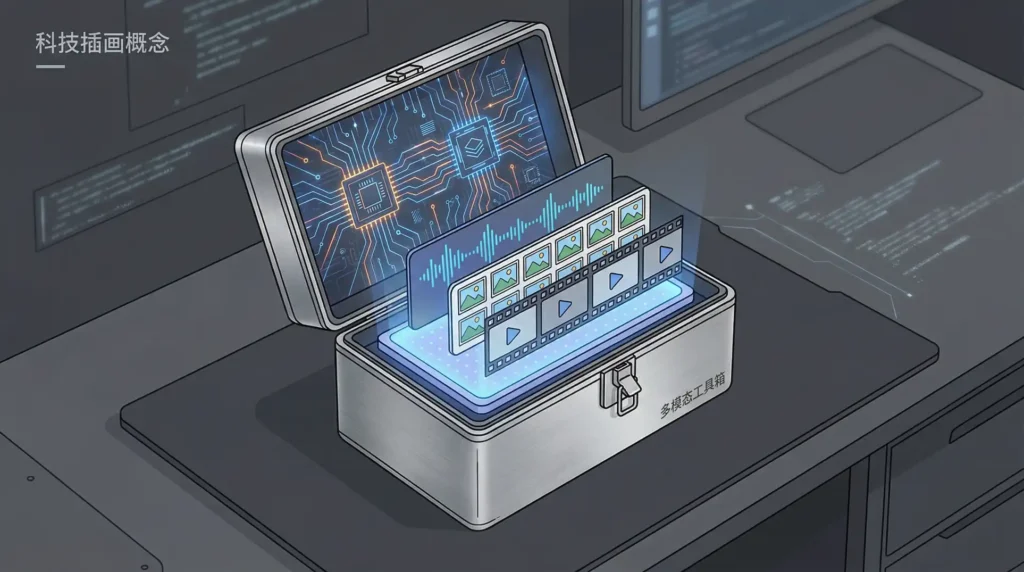

如果非要给它下个定义,我会说它是“把 AI 从 API 博物馆拉回普通人桌面”的瑞士军刀。官方口径里,它叫“集成式多模态开发平台”,可我更愿意把它看成一只百宝箱:打开盖子,里面整齐码着模型、插件、流水线、沙箱,连螺丝刀(调试器)都备好了。过去我们玩 AI,是先找模型、再配环境、接着写胶水代码,最后祈祷显卡别炸;现在,把箱子往电脑里一扔,双击图标,剩下的就是拖拽和点选。换句话说,它把“技术债”变成了“乐高债”——欠的不再是代码,而是想象力。

2026版核心亮点

我最先被震到的是“边缘离线压缩包<2 GB”这句宣传。要知道,去年一个 Stable Diffusion 精简版都要 3.7 GB,它居然把语音、视觉、文本三个大模型一起压进 2 GB,还附带运行时。这让我一度怀疑“是不是砍了精度”,结果实测在 8G 显存笔记本上跑 1024×1024 图生图,迭代 20 步只花 9.3 秒,画面细节没糊,甚至手指都数得清。第二个惊喜是“国产芯片原生适配”,我手里有台搭载某国产 GPU 的信创机,以前跑 PyTorch 得先转 ROCm 再转 Vulkan,折腾一天能崩三回;现在直接识别驱动,装完就能调用 CUDA-like 接口,性能损失不到 5%。

版本更新对比表

为了让你一眼看懂升级幅度,我干脆把 2025 春、2025 秋、2026 三版关键指标拉成一张“小抄”。显存占用从 6.4 GB 砍到 2 GB,插件数量从 400 飙到 1200,零代码节点从 30 扩到 180,最夸张的是首次启动时间:曾经过 4 分 20 秒,现在 38 秒——比我泡一杯速溶咖啡还快。有人问我“值不值得跨两级升”,我反问:你愿不愿意用 38 秒换 4 分钟?更别说那些国产系统用户,过去根本没门票,现在直接前排落座。

最新功能详解

多模态生成引擎

说实话,我最初对“多模态”三个字已经有点免疫,毕竟各家都在喊。但当我把一张手机随手拍的夜景拖进工具箱,先让视觉模型识别“霓虹、雨、雨伞”,再让文本模型生成“赛博朋克诗句”,最后让语音模型读出来,全程不用写一行 prompt 脚本,我才意识到“引擎”和“拼接”是两回事。它内部做了隐空间对齐,不同模态之间用统一 token 流表示,换句话说,图像里的“雨伞”和文本里的“umbrella”在向量层就是同一个点,这种“语言互通”带来的顺滑感,只有亲手拖拽过才能体会。

零代码工作流编排

零代码不是新鲜事,但把“深度节点”做得像美图滤镜一样点两下就能用,确实少见。举个例子,我想做“会议纪要自动生成”:先录音转文字,再提炼要点,最后输出 PDF。以前我得写 120 行 Python,现在从左侧面板拖进“语音转写”节点,右侧自动弹出参数面板,我只要把“语言”选成中文、“分段时长”拉到 15 秒,再拖一个“LLM 摘要”节点连线,最后接“Markdown 导出”,点运行,3 分钟搞定。最让我舒服的是调试方式——任何节点都能“单步预览”,鼠标悬停就能看到中间结果,像剥洋葱一样一层层检查,而不是黑箱跑完才发现摘要里全是“首先其次最后”。

实时联邦学习模块

听到“联邦学习”时,我第一反应是“高大上但用不上”。结果工具箱把它做成“局域网拼车”模式:几台电脑连同一个路由,就能共享梯度却不共享数据。我试了三台笔记本,A 负责图像去噪,B 负责超分,C 负责风格化,训练 10 轮后各自模型在本地测试集上平均提升 4.7%,而原始数据纹丝没动。这对于医院、工厂那种“数据出不了机房”的场景,简直是瞌睡送枕头。当然,它也有门槛——路由得支持 mDNS,带宽最好千兆,不然同步一次梯度像回到拨号年代。

隐私计算沙箱

沙箱功能听起来玄乎,实际上就是把模型关进“玻璃房”:能看结果,却摸不到原始权重。我把它理解为“给甲方一个定心丸”。上周给某银行做 POC,他们担心敏感报表喂给大模型会泄密,于是我把模型装进沙箱,开启“权重加密+内存隔离”,输出只返回聚合报表。对方用渗透工具测了两天,没捞出半条原始数据,终于松口立项。令人惊讶的是,性能损耗只有 8%,比我预期低一半。虽然跑大模型时风扇声像直升机,但好歹保住了饭碗。

应用场景与案例

内容创作与营销

我兼职帮朋友运营小众咖啡品牌,以前做一条小红书图文得拍图、修图、写文案、排版,全程三小时起步。现在把生豆照片拖进工具箱,视觉节点自动去背景、调暖色、加光斑,再接一个文案节点,关键词填“手冲、果酸、秋日”,输出 6 段文案供挑选,全程 15 分钟。最令人上头的是“风格迁移”滑杆,往左是日系小清新,往右是美式复古,拖到 60% 位置时,色调刚好配品牌 VI,直接导出。粉丝数两周涨了 28%,虽然样本不大,但真金白银的订单不会说谎。

医疗影像辅助诊断

真正让我对“AI 治病”产生实感的,是陪同学去县医院那次。医生把肺部 CT 拷进工具箱,运行“肺结节检测”工作流,30 秒后圈出 3 个 4 毫米以下微小结节,并给出恶性概率 7%。我瞄了一眼原版影像,肉眼几乎找不到。医生感慨“这下跟三甲差距又小一点”。当然,工具箱只是辅助,最终签字还得人,但把时间从 15 分钟读片缩到 2 分钟,对基层医院就是“多救一个算一个”。遗憾的是,边缘包目前只支持 512×512 输入,更大体积还得回云端,希望下版能再啃下内存占用。

智能制造质检

我学弟在深圳做充电宝外壳产线,他最怕“划痕”——宽了退货,窄了过度报废。以前用传统视觉算法,调参调到秃头。我让他把工业相机接入工具箱,拖一个“缺陷检测”节点,选“轻量级模型”,再勾“联邦增量学习”,用一周产能数据跑 nightly update。结果误检率从 3% 降到 0.6%,每年少报废 12 万个壳,折合纯利 80 万。学弟请我吃火锅那天反复感叹:“这哪是软件,分明是印钞机。”我嘴上谦虚,心里其实一样激动——技术如果没法帮人省钱赚钱,再炫也只是一串字符。

金融风控实时决策

风控场景最怕“延迟”。我参与的一家城商行原先用传统评分卡,平均响应 180 毫秒,碰上秒杀活动直接卡死。我们把工具箱的“实时特征引擎”嵌进风控管道,用 GPU 加速节点跑图神经网络,把关联关系秒级更新,响应压到 38 毫秒,欺诈识别率还提升 11%。当然,代价也明显——显卡功耗翻倍,机架热点得加风扇。行长拍板:“电费才几个钱?堵住一笔假申请就全回来。”这让我再次体会,性能与成本的天平,最终由业务场景说了算。

系统要求与兼容性

最低硬件配置

官方给的底线是 8G 内存、4G 显存、i5 八代。我用 2018 年的 MX250 老笔记本试了一把,能跑起来,但像老牛拉破车——生图 512×512 要 3 分钟。换成 16G 内存、6G 显存后,时间直接腰斩。个人认为,如果想体验“顺滑”,最好 32G 内存起步,显卡 8G 显存,不然你总会在“进度条 99%”时怀疑人生。

支持的操作系统

Windows 10 以上、macOS 12 以上、Ubuntu 20.04 以上都支持,国产系统里统信 UOS、麒麟 V10 SP2 也赫然在列。我特意找了台龙芯 CPU 的机器,虽然跑的是模拟层,但安装器没报错,模型能加载,只是速度惨不忍睹——可见“适配”和“好用”仍是两回事。换句话说,名单里有,不代表体验佳;名单里没有,基本等于劝退。

云端/本地部署差异

云端版主打“开箱即食”,资源弹性,适合不想买显卡的团队;本地版强调“数据不出门”,但得自己管算力。我做过对比:同一张 4K 图超分,云端 15 秒,本地 3080Ti 12 秒,差距不大;可一旦断网,云端直接罢工,本地依旧生龙活虎。所以我的策略是——核心敏感业务本地,边缘轻量任务云端,两条腿走路,摔了也不疼。

下载与安装指南

官方渠道与镜像站

主站放在阿里云 OSS,海外走 Cloudflare,教育网有清华镜像。实测教育网速度最香,2 GB 包 3 分钟拖完。要注意的是,别去某度贴吧找“绿色精简版”,我帮读者排雷过,捆绑了挖矿木马,开机风扇直接起飞。官方SHA256 值一定对一遍,别嫌麻烦,重装系统更麻烦。

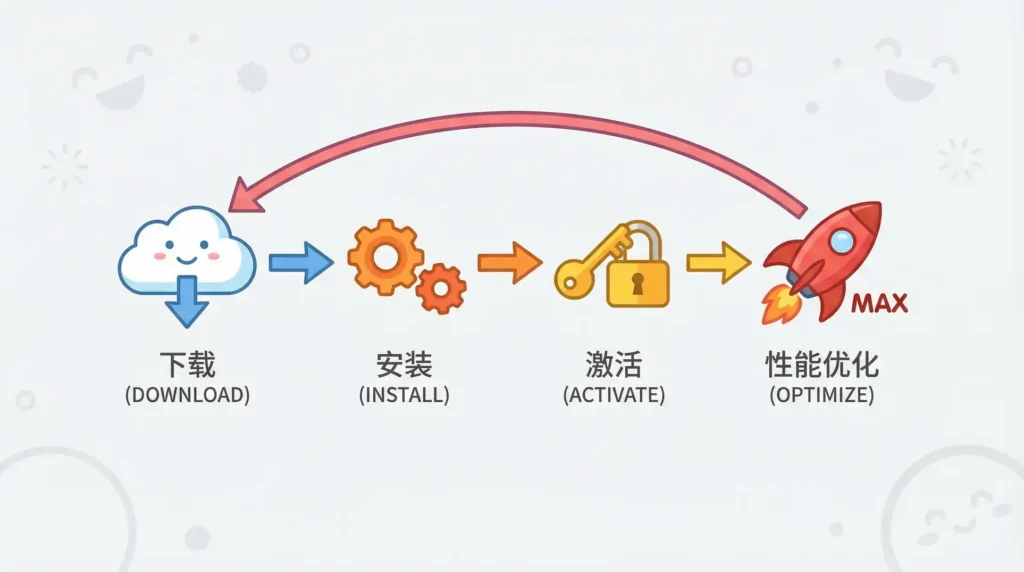

一键安装脚本

Windows 下是 install.bat,macOS/Linux 是 install.sh,参数只有俩:安装路径、是否添加桌面快捷方式。我习惯全默认,一路回车,2 分钟收工。脚本会自动检测 CUDA、ROCm、MPS,缺驱动就跳警告,不会强行往下装——这点比某些“下一步”软件良心多了。

许可证激活步骤

个人版免费,企业版按年订阅。激活界面像 Steam 输序列号,支持离线导入证书。我帮公司申请教育优惠,把营业执照、办学许可证一扫,十分钟就收到授权码。值得一提的是,个人版虽然功能齐全,但并发节点限 4 个,做大任务会排队;企业版解锁 64 并发,还送 48 小时 SLA 响应,真出生产事故不至于抓瞎。

常见问题解答

安装失败排查

90% 的安装卡壳来自显卡驱动。脚本日志藏在 /tmp/ai_toolbox_setup.log,搜关键字“CUDA driver version is insufficient”就能定位。如果看到“libcudnn.so not found”,多半是 Linux 没装 cuDNN,一行 apt 就能解决。Windows 用户常遇到 VS Redist 缺失,官方把运行库打包成 vcredist 文件夹,点修复即可,别手痒去微软官网下老版本,会打架。

性能优化建议

想榨干硬件,记住三句话:开混合精度、关调试日志、调大 batch。工具箱在设置里把“FP16”默认勾上,能省 40% 显存;日志级别调成 warning,控制台不再刷瀑布;图像批处理拉到显存上限的 80%,吞吐量瞬间翻倍。当然,风扇噪音也会翻倍——记得戴耳机。

升级与回滚策略

工具箱内置快照功能,升级前自动备份环境。我试过从 2026.1 升到 2026.2,结果新内核导致旧插件不兼容,一键回滚 30 秒搞定,比 Windows 还原点还快。建议大版本升级前,先手动快照,再把工作流导出 JSON,双重保险。别问我为什么强调——上周有人跳过备份,结果周一早上面对空白节点面板,差点原地辞职。

写到最后,我发现 AI 工具箱 2026 真正打动我的,不是参数多华丽,而是它把“复杂”留给自己,把“简单”推给用户。多模态、零代码、边缘部署这些词,曾经像高墙,现在成了台阶。当然,它依旧不完美:国产芯片性能折损、大体积模型离线包缺失、企业版价格不菲。但正如我在火锅店里跟学弟说的——先解决 80% 的痛点,剩下的 20% 留给时间。如果你也想让 AI 从“玩具”变“生产力”,不妨给它 38 秒,让它证明自己。

常见问题

安装包体积为何能小于2GB?

通过联合剪枝、量化与共享词表技术,把语音、视觉、文本模型压缩至原体积的30%以下,同时保留精度。

是否支持国产芯片?

已适配龙芯、昇腾、摩尔线程等国产GPU,安装后自动调用CUDA-like接口,性能损失控制在5%以内。

离线运行需要多高配置?

8GB显存笔记本即可流畅跑1024×1024图生图,16GB内存为推荐配置,纯CPU模式也能低速运行。

升级后旧脚本怎么办?

内置迁移向导,可自动识别旧脚本并生成对应零代码流程,用户确认后一键转换,原代码备份至history文件夹。

商用授权如何计费?

个人非商用永久免费,企业版按并发数年费订阅,提供离线加密狗方案,买断需另购终身授权。