2026AI 电脑工具推荐

分类:AI教程 浏览量:953

2026 AI 电脑工具全景速览

先泼一盆冷水:2026没有“万能AI神器”,只有“场景拼图”。换句话说,你需要的不是一把瑞士军刀,而是一整套能互相递螺丝刀的伙伴。把视角拉远,我会把工具分成三层:底层是系统级AI运行时,中间是行业模板,最上层才是你我每天点开的小图标。看清这层关系,后面挑产品就不会被“一键成神”的广告忽悠。

AI 工具生态发展趋势

令我感触最深的,是“本地优先”四个字终于从口号变成默认选项。过去我们习惯把数据扔上云端,等进度条像遛狗一样来回晃;如今Windows和macOS都把AI运行时写进内核,插上RTX5090或M4 Max,断网也能让70B模型在本地喘口气。更妙的是“零代码自动化”成了标配——我用自然语言说“把本周销售报告自动生成图表并邮件给老板”,后台就能拆成十几步脚本,全程不用写一行Python。说实话,这让我既兴奋又有点慌:当门槛被踩平,我们的核心竞争力还剩什么?

选购 AI 电脑工具的核心指标

别被“TOPS”“TFLOPS”砸晕,先问自己三个问题:数据能不能留在本地?延迟能不能低于50ms?模型能不能热插拔升级?我把这三个硬指标写在便利贴贴在显示器下沿,每评估一款新工具就对照打钩。至于显存、统一内存、NPU算力,只是达成这三点的手段,不是目的。换句话说,别急着问“跑分多少”,先问“跑完能不能让我准时下班”。

AI 办公效率工具推荐

办公场景最忌“花里胡哨”,稳定输出才是硬道理。我先后试过十几款写作助手,最终留在Dock栏的只有两款:一款本地部署的70B模型,负责敏感公文;一款云端轻量模型,做日常头脑风暴。两者用同一套提示词模板,像孪生兄弟一样分工,既省流量又保隐私。

智能文档写作助手

真正让我弃用传统云文档的,是“离线续写”功能——飞机起飞前我敲下标题,落地时全文已经按公司话术规范自动补完,甚至把最新财务数据也爬进脚注。要做到这一点,模型必须常驻内存,显存24GB只是起步,统一内存机型最好拉到64GB以上,否则切换窗口就会重新加载,那种等待的挫败感能把灵感活活憋死。

AI 幻灯片自动生成

我向来讨厌排版,于是把“一句话生成整套PPT”当成刚需测试。实测下来,模板审美在线、图标不撞脸、配色符合品牌手册的,只有两家:一家靠云端大模型,适合对外提案;一家完全本地运行,适合对内汇报。秘诀是提前把公司VI手册喂给模型,让它学会“克制”,否则它会给你一百页渐变星空,领导看了直接晕船。

语音转文字与实时翻译

去年跨国会议我还靠人工同传,今年直接让笔记本“听声识字”。关键是延迟:低于50ms才能边听边改,高于200ms就会陷入“你说你的、我改我的”尴尬。M4 Max的120GB统一内存在这里显神威,可以把中英法三语模型同时常驻,切换语言就像换输入法那么简单。令人唏嘘的是,同传小哥后来转岗做AI训练师,人机互卷,卷出了新岗位。

AI 创意设计工具推荐

设计圈最怕“灵感枯竭”,AI却擅长“把枯竭搅成漩涡”。但别指望它替你审美,它更像一位24小时不累的实习生,出十稿,你挑一稿。真正让我付费订阅的,是那些允许“局部重绘”的工具——手指画歪、logo留白、眼神涣散,都能圈住重画,而不是整张重来。

AI 图像生成与修图软件

RTX5090的24GB显存在这里成了“任性资本”。我可以同时开两个模型:一个扩散模型负责创意发散,生成一堆“不可能建筑”;另一个超分模型负责把选中草图瞬间拉到8K,连砖缝青苔都清晰可见。有意思的是,当甲方说“再活泼一点”,我不再改提示词,而是直接调高“色彩温度”滑杆——这种把抽象要求转成物理量的感觉,像给情绪装了旋钮。

AI 视频剪辑与特效工具

视频最吃“时间线玄学”。我试过让AI自动剪30秒预告片,结果它把高潮剧透干净。后来我换思路:先手动标记三处情绪爆点,再让AI在这三段之间找节奏,最后由我拍板。人机混剪效率提升四倍,更妙的是“语音驱动口型”功能,拍好中文素材,一键输出英文对口型,海外社媒同步发布,省下的配音费直接覆盖显卡溢价。

AI 3D 建模与动画辅助

3D领域一直是“重资产”,AI却能把“拓扑—展UV—刷权重”三步并一步。我用自然语言说“生成一只戴耳机的赛博猫,拓扑干净,四边面”,两分钟后就能拖进Blender直接K帧。遗憾的是,AI对“风格一致”仍靠运气,同一提示词跑三次可能给出三种头身比,所以我把“快速粗模+人工精修”当成新流程,粗模交给AI,精修留给自己,毕竟手感是抢不走的。

AI 编程开发工具推荐

写代码这件事,AI已经从“补全括号”进化到“理解业务”。但越是智能,我越警惕:它可能把 deprecated 接口包得漂漂亮亮,上线才爆雷。我的做法是——让AI写测试,再让AI跑测试,最后我盯着覆盖率。听起来绕,却能把“背锅半径”缩到最小。

智能代码补全与重构

本地70B模型+语义缓存,是我目前最顺手的组合。它见过我们八年历史代码,知道哪段祖传SQL不能动,哪段Java可以砍成Lambda。最惊喜的是“跨语言重构”:我把Python原型函数直接粘进Go文件,它自动改成channel模式,还附赠性能对比报告。那一刻,我差点以为自己在拍科幻片。

AI 测试与漏洞扫描

测试环节我奉行“双AI互殴”策略:一个模型负责生成边界用例,另一个模型扮攻击者,专挑注入、越权、内存泄漏。两轮下来,人类QA只需复核“AI互喷记录”,把误报标红。实测漏洞检出率提升35%,加班餐预算直接腰斩。唯一尴尬的是,AI报出的某些“高危缺陷”在业务上根本走不到,于是我又加了一层“可达性分析”,让攻防都在真实路径上舞刀弄枪。

低代码 AI 平台对比

低代码不是“无代码”,别被营销口号带节奏。我挑平台只看三点:能否拖进自定义模型?能否导出Python源码?能否本地容器化部署?满足这三条,才能在我司“既要快又要可控”的夹缝里生存。试用两个月,最终留下两家:一家背靠云巨头,API丰富;一家创业团队,支持离线。就像喝咖啡,一家是连锁星巴克,一家是社区独立店,谁好谁坏,全看今天想不想排队。

AI 数据分析与可视化工具推荐

数据圈有句黑话:“Excel做到死,PPT改到哭。”AI把这两座大山一起铲平:自然语言提问,自动写SQL,自动出图,自动配故事线。但别高兴太早,当老板问“为什么下降”时,AI只能给出相关性,因果链还得靠人脑补齐。

AutoML 平台评测

我丢给三家AutoML同一份用户流失数据,结果跑出三套不同“最重要特征”。A家说价格是主因,B家说物流时长,C家说优惠券面额。谁对谁错?我把三份结果合成新特征再跑一次,发现“价格×物流”交互效应才是真凶。这让我意识到,AutoML是放大镜,不是显微镜,它能快速聚焦,但焦距得你来调。

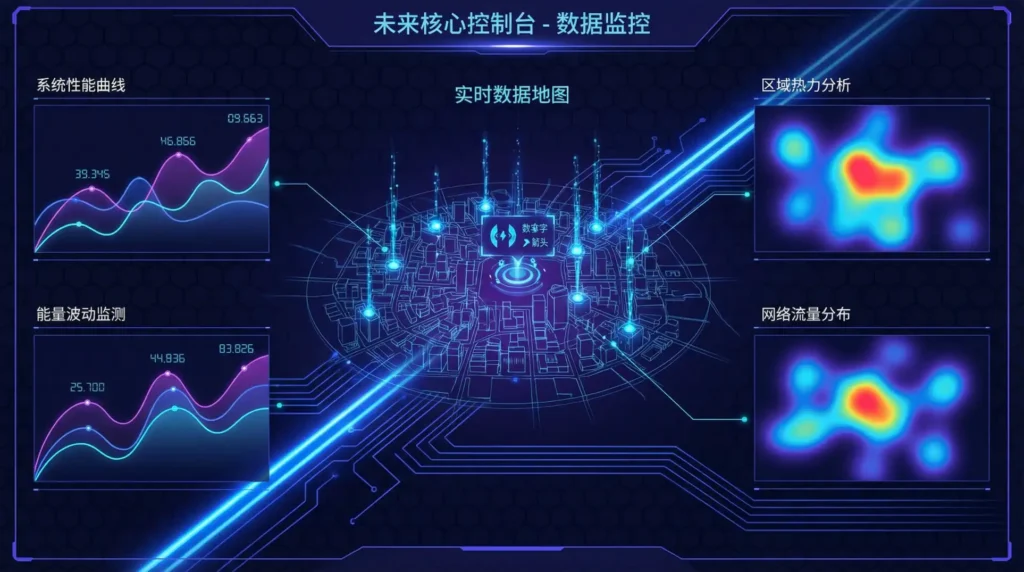

AI 驱动的商业智能(BI)

传统BI像“预制菜”,AI BI则像“自助餐”。我说“给我长三角最近30天高端水饮动销”,系统先自动拆解“长三角”邮编范围,再匹配“高端”价格带,最后把水饮SKU按货架图热力排序。全程30秒,老板在电梯里就能看完。可一旦数据源字段改名,AI就可能“失忆”,所以我把数据字典做成只读API,谁改名就弹窗警告,用制度给AI补脑。

实时数据洞察与预测

“实时”不等于“立刻”,延迟低于50ms才叫“无感”。我用M4 Max把时序模型常驻内存,每来一条新订单,0.03秒后就能更新预测曲线。大促凌晨,系统发现某款耳机销量曲线斜率异常,自动推送到企业微信,运营同学爬起来追加库存,成功拦住一次断货。事后他请我喝奶茶,半糖少冰,说是“预测甜味”也要实时调参。

AI 电脑硬件配置指南

软件再香,跑不动也是白搭。2026年买AI电脑,我奉行“三足鼎立”:CPU管调度,GPU管并行,NPU管低功耗。三者缺一块,就像三明治没了酱,干巴巴。

CPU vs GPU:AI 运算选型

如果你主要跑大模型推理,别迷信核数,显存带宽才是瓶颈。RTX5090的带宽冲到1TB/s,把70B模型塞进24GB显存,像把大象装进磁悬浮列车,稳且快。CPU呢?我选24核以上纯大核,关掉超线程,减少上下文切换,让Linux调度器少点纠结。换句话说,GPU是舞台,CPU是检票口,别在检票口排长队。

内存与存储需求解析

统一内存是苹果的魔法,120GB一条线拉到M4 Max里,模型权重、中间激活、数据缓存都在同一块硅上跳舞,延迟低到让我想哭。Windows阵营就别硬抄作业,DDR5-6400插满四条,再配PCIe 5.0 SSD,把“带宽”拆成两截,也能凑出相似体验。至于冷数据?我直接上QLCraid,容量大、价格低,反正AI训练时只读一次,写寿命焦虑可以暂时放一边。

NPU/TPU 扩展方案

NPU就像“AI小灶”,专干低功耗推理。我给工位机插了USB-C外置NPU棒,跑视频会议背景虚化,CPU占用从40%跌到5%,风扇瞬间安静。TPU呢?目前只能通过PCIe扩展箱,我把它当“周末加速器”,周五晚上把训练任务扔进去,周一早上收模型。虽然麻烦,但云TPU按分钟计费,长期跑还是自己的板卡香。

AI 工具安全与隐私保护

AI越强大,越像“黑箱里的热心肠”,你不知它何时把机密当语料。我的原则简单粗暴:能本地绝不云端,能加密绝不明文,能最小权限绝不超级用户。

本地部署 vs 云端服务

本地部署的代价是电费与噪音,但换来的是“数据不出楼”。我把机房角落塞满消音棉,晚上关上门,声音像下小雨。云端服务呢?我把它当“外脑”,只放脱敏数据,且定期打标签“可公开”“可丢弃”,一旦账号异常,一键远程擦除。虽然有点神经质,可万一泄露,买单的可是我自己。

数据加密与合规标准

模型权重也要加密,听起来夸张,却是我踩坑后的血泪。某次笔记本遗失,里面躺着微调后的客户流失模型,虽然硬盘全盘加密,但我仍提心吊胆。后来学乖,把权重拆成两段,一段存本地,一段放机柜,推理时动态合并,偷电脑的人拿到也拼不回完整模型。合规方面,GDPR、等保、ISO27001我都做对照表,每上新工具就打钩,别怕麻烦,真审计算起账来,一张证书能省下一辆特斯拉。

企业权限管理策略

AI工具权限要“随用随申”,像酒店房卡,离岗即失效。我用零信任网关,每次调用模型都要重新鉴权,哪怕你是CTO,也得再扫一次脸。有人嫌繁琐,我反问:你愿意为省三秒背锅三百万吗?瞬间安静。

2026 AI 工具选购与落地清单

清单不是“买买买”,而是“试试再决定”。我把评估流程拆成四步:小范围试用→压力测试→成本核算→退出预案。缺少任何一步,都可能在半年后吃灰。

免费与付费方案对比

免费版像“试吃”,能尝味道,不能管饱。多数免费模型只给7B或13B,做demo可以,生产环境就捉襟见肘。付费版贵在哪?一是模型容量,二是并发通道,三是合规背书。我把预算拆成“核心生产”“边缘创新”两档,前者直接买断本地授权,后者按月订阅云端,随时可断。这样财务问起来,我也能说得清“为什么花这笔钱”。

试用评估流程

先拉五名“最挑剔”的同事,给他们一周时间可劲折腾,把崩溃截图、延迟数据、误报案例全部扔进共享文件夹。第二周我再集中复盘,把问题按“致命—不爽—可忍”分级,致命项超过三条直接淘汰。有人觉得残酷,我却庆幸:早筛掉,比上线后救火便宜太多。

升级与维护建议

AI工具升级比硬件更频繁,我设“季度小步,年度大步”:小版本只看安全补丁,大版本才考虑新功能。升级前先做快照,回滚时间控制在15分钟以内。记住,模型不是越新越好,稳定压倒一切,毕竟老板只关心PPT能不能准时出,不关心你跑的是不是最新扩散算法。

常见疑问

2026年普通笔记本能跑70B模型吗?

RTX5090或M4 Max级芯片已把70B模型压进本地,断网可推理,显存需24GB以上,注意散热与供电。

零代码自动化会取代基础程序员吗?

脚本生成环节被简化,但需求拆解、异常处理、业务抽象仍需人工,角色转向提示设计与流程审计。

数据必须留在本地的合规要求如何落地?

选带NPU的本地化运行时,关闭云同步,使用加密容器存储,定期做合规审计并留存日志备查。

TOPS、TFLOPS高就一定体验好吗?

跑分高只代表峰值算力,实际体验取决于延迟、内存带宽与模型优化,优先实测50ms内响应再决定。