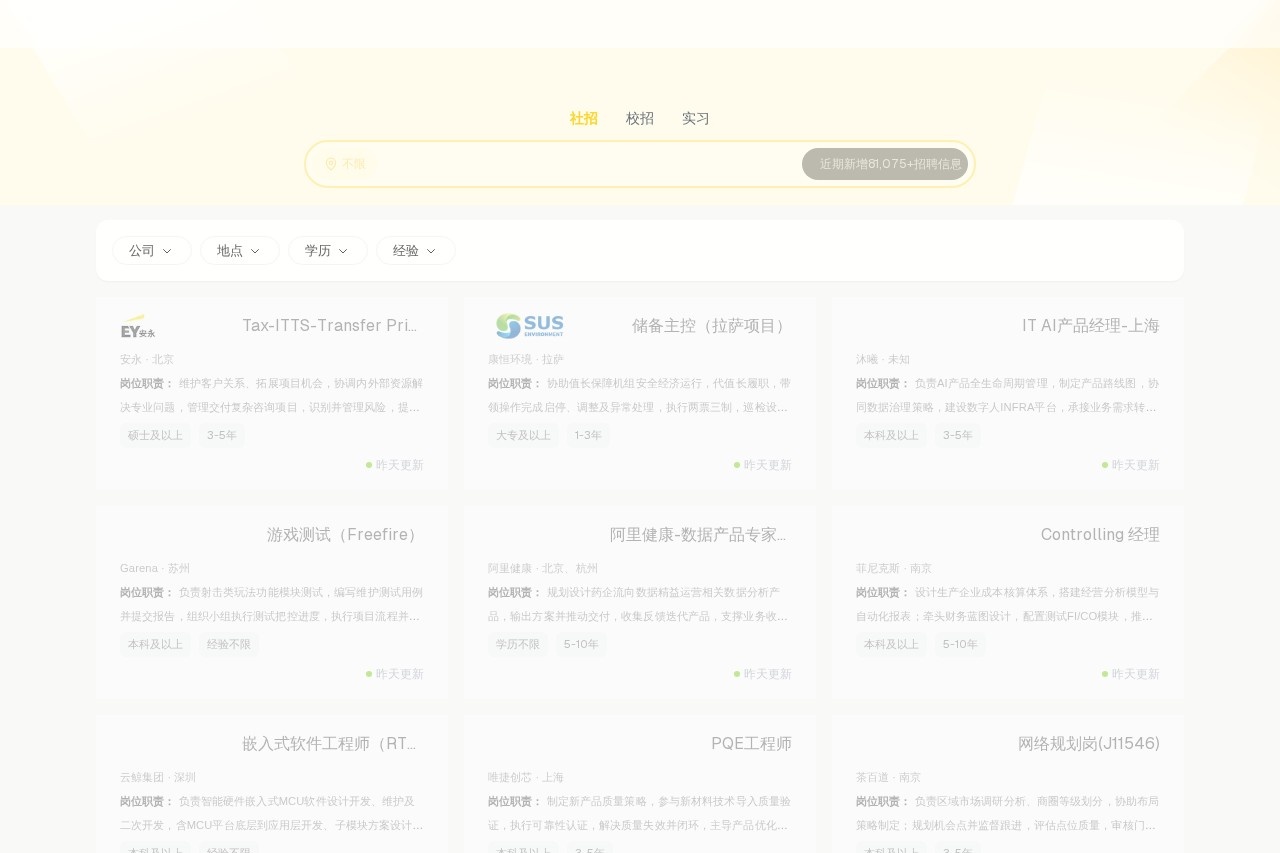

Midjourney v6版本更新,图像生成细节与连贯性显著提升

分类:AI教程 浏览量:86

说实话,作为一个长期关注AI绘画领域的人,Midjourney v6的发布确实让我眼前一亮。要知道,在v5版本已经相当惊艳的基础上,很多人可能觉得进步空间不大了。但这次更新,尤其是在图像细节和画面逻辑连贯性上的提升,在我看来,不仅仅是技术迭代,更像是一次创作工具“理解力”的质变。它开始真正尝试去“读懂”我们那些复杂、甚至有点天马行空的描述,并把它们编织成一个合理、可信的视觉世界。接下来,我想和你聊聊这次更新里那些让我个人觉得特别有意思的地方,从肉眼可见的纹理突破,到背后可能的技术思路,以及它对我们这些使用者实实在在的影响。

Midjourney v6版本核心更新概览

每次Midjourney大版本更新,社区都像过节一样。但v6带来的兴奋感,似乎有点不一样。它没有停留在“更逼真”这个模糊的口号上,而是非常明确地指向了两个核心痛点:细节的丰富度,和画面内在的逻辑性。

v6版本发布背景与主要目标

在v5时代,我们已经能生成许多足以乱真的单张图像了。但不知道你有没有这样的经历:当你试图生成一个复杂场景,比如“一个老工匠在布满工具的作坊里制作皮具,窗外是黄昏”,结果出来的画面,可能老工匠的手部结构奇怪,工具散落得毫无空间感,窗外的光影和室内也对不上。这其实就是AI在“细节堆砌”和“整体理解”上的瓶颈。我个人认为,v6的主要目标,就是正面攻克这两个问题。它想让生成的图像,不仅“好看”,更要“讲得通”。

图像细节生成能力的突破性进展

这可能是最直观的进步。我们过去总抱怨AI画的东西“经不起放大看”,v6在很大程度上改变了这个印象。举个例子,你让它画一件毛衣,现在它真的能呈现出针织的纹理、毛线的蓬松感,甚至是一些轻微的起球细节,而不是过去那种光滑得像塑料的质感。这种从“形状模拟”到“材质表达”的跨越,让图像有了触感,这是非常了不起的。

画面连贯性与逻辑一致性提升

另一个让我感慨的点是连贯性。比如说,你生成一个“小女孩在雨中奔跑,回头微笑”的序列。在以前,可能四张图里小女孩的衣着、发型甚至长相都会有微妙差异,雨滴的方向也乱七八糟。但现在,v6能更好地保持主角的一致性,并且让雨滴的方向、人物奔跑的动势都符合物理逻辑。这听起来简单,但对AI来说,意味着它需要理解整个提示词描述的是一个“动态事件”,而不是四个独立的静态画面。这背后的进步,可能比单纯的画质提升意义更大。

细节生成:从宏观到微观的革新

如果说v5是在搭建坚实的骨架和轮廓,那么v6就是在为这副骨架注入血肉和灵魂。这种细节的革新,是层层递进的。

纹理与材质表现力的显著增强

我们来看看材质。无论是金属的冰冷锈蚀、木材的年轮纹理、玻璃的剔透与折射,还是石头的粗糙颗粒感,v6的表现都上了一个大台阶。有意思的是,它似乎开始理解材质与环境的关系。一块放在潮湿环境中的铜器,生成的锈迹和光泽,与放在干燥橱窗里的就是不同。这种关联性理解,让细节不再是孤立的装饰,而成了叙事的一部分。

复杂光影与反射效果的精准渲染

光影一直是数字艺术的灵魂,也是最难模拟的部分。v6在复杂光源和反射处理上,显得更加“自信”了。比如一个室内场景,有窗户的自然光、桌上的台灯和墙上的壁灯,现在生成的结果中,物体的投影方向、高光位置、以及相互之间的色彩影响(比如灯光在金属表面的暖色反射),都合理了很多。它开始有了一点“全局光照”的意识,虽然还不能与专业的3D渲染器相比,但这个方向令人惊喜。

微小元素(如毛发、织物)的生成优化

说到这个,我不得不提对毛发和织物的处理。这曾经是AI图像的“重灾区”。现在的v6,画动物时,毛发不再是糊成一团,而是有了流向、疏密和光泽的变化。织物的褶皱也不再是生硬的线条,而是能看出布料厚度和垂坠感的自然起伏。根据我的观察,这不仅仅是算法算得更细了,很可能在训练数据中,这类特写细节的质量和标注精度得到了大幅提升。要知道,教会AI分辨天鹅绒和灯芯绒的差别,可比教会它画一只猫难多了。

连贯性提升:构建更合理的视觉叙事

细节是砖瓦,连贯性则是将这些砖瓦砌成一座稳固、可居住的房子的蓝图。v6在这方面的努力,或许标志着AI图像生成从“快照”走向“叙事”的开始。

多对象场景中空间关系的准确表达

你有没有试过生成一张“餐桌上摆满丰盛食物”的图?在旧版本里,盘子可能飘在空中,酒杯和桌子的透视关系错乱。v6显著改善了这一点。物体之间的前后遮挡、大小比例和透视关系都更加准确。这暗示着模型对三维空间有了更好的隐式理解。它不再是把一堆“食物”和“桌子”的图片元素拼贴在一起,而是在尝试构建一个统一的、有深度的场景。

动态序列图像的逻辑一致性改进

这是我最想称赞的一点。使用“--weird”参数或通过特定提示词生成多张关联图像时,v6能更好地维持角色、风格和环境的稳定性。比如你生成一个漫画分镜,主角在整个序列中的服装、发型特征能保持住,背景环境也不会突兀地切换。这对于想用AI做故事板、概念叙事的设计师来说,简直是福音。它减少了大量后期统一调整的工作,让创作者能更专注于故事本身。

长提示词理解与整体画面协调性

过去,我们写长提示词有点像碰运气,AI经常会抓住一两个关键词猛做文章,忽略其他。v6的“阅读理解”能力更强了。它能更好地权衡长提示词中各个元素的重要性,并协调它们之间的关系。例如,“一座被薄雾笼罩的森林,深处有一座发光的精灵小屋,门口站着一位持杖的长耳精灵,月光透过树叶洒下斑驳光影”这样一个复杂的描述,v6生成的画面中,雾气的浓度、小屋的光与森林的暗、精灵的比例以及月光的方向,更有可能形成一个和谐的整体。这大大提升了我们通过语言精准控制画面的能力。

技术升级与模型架构优化

当然,所有这些用户体验的提升,都不是凭空发生的。背后肯定有一系列深刻的技术变革。虽然Midjourney官方不会公布所有细节,但我们能从结果反推一些可能的改进方向。

底层模型算法的重要改进

我个人猜测,v6很可能采用了更先进的扩散模型变体,或者在去噪过程中引入了更强的先验知识约束。比如,在生成过程中,不仅考虑像素级别的匹配,还可能加入了对于物体结构、物理规律的隐性判断。这样才能解释为什么物体的结构更稳固,光影更合理。换句话说,模型在“想象”画面时,脑子里多了一本关于世界如何运作的“常识手册”。

训练数据质量与规模的提升

数据是AI的粮食。v6令人惊叹的细节表现,绝对离不开更高质量、更高分辨率的训练数据。特别是那些带有精细材质特写、复杂光影效果的图像数据,其比例很可能被大幅增加了。而且,数据的标注(如果有的话)可能也更加细致,不仅仅是“猫”、“狗”,或许包含了“波斯猫的长毛”、“柯基犬的短腿”这样的属性描述。这能让模型学习到更细粒度的特征关联。

提示词解析与执行效率优化

我们输入的提示词,首先要被模型“翻译”成它能理解的内在指令。v6的这个“翻译器”显然升级了。它可能采用了更强大的自然语言处理模块,来理解词语之间的修饰关系、主次顺序和逻辑连接。比如,“穿红色裙子的女孩”和“女孩,穿着红色的裙子”,在v6看来可能比以往版本更接近同一个意思。这种解析能力的提升,直接决定了我们与AI沟通的顺畅程度。

实际应用场景与创作影响

技术再酷,最终还是要落地到创作中。v6的到来,正在悄悄改变很多创意工作者的流程和思维方式。

概念艺术与插画创作的细节突破

对于概念艺术家和插画师来说,v6就像一个不知疲倦、灵感爆棚的超级助手。现在,你可以快速生成一张充满可信细节的关键帧插图:盔甲上的战损划痕、魔法师袍子上的神秘符文、异星地貌的奇特岩石结构……这些过去需要花费大量时间手动描绘的细节,现在可以由AI提供一个高质量起点。艺术家可以将更多精力集中于构图、色彩情绪和故事性的把控上,这无疑会大大提升创作效率和质量上限。

产品设计与广告视觉的实用性提升

在产品设计和广告领域,视觉稿的“质感”至关重要。v6生成的产品渲染图,在材质、光影和场景融合度上更加逼真,使得它在创意发散和方案预览阶段的价值大增。你可以快速看到新设计的沙发在不同布料、不同灯光环境下的效果,或者将一款新饮料置于各种充满氛围的生活场景中。这种快速、高质量的视觉化能力,能加速决策过程,并激发更多创意碰撞。

叙事性图像与漫画制作的连贯性支持

如前所述,连贯性的提升是游戏规则的改变者。对于漫画作者、独立游戏开发者或短视频创作者,现在可以利用v6生成风格统一、角色连贯的系列图像,作为故事板、背景或直接使用的素材。虽然目前还无法完全替代手工绘制,但它能高效地解决“氛围铺垫”和“场景构建”这类耗时工作,让创作者更专注于核心的角色表演和剧情推进。这可能会催生出一批新的、融合AI辅助的叙事创作模式。

用户使用指南与技巧

面对一个更强大的工具,我们的使用方法也需要一些调整。这里分享一些我个人基于测试的体会,或许能帮你更快上手v6。

如何利用v6版本最大化细节表现

首先,要敢于描述细节。在提示词中,多使用具体的材质、纹理和光影形容词。比如,不说“一件衣服”,而说“一件粗纺羊毛制成的、带有细微起球痕迹的燕麦色开衫”。其次,可以尝试使用“细节特写”、“宏观摄影”、“8K分辨率”这类质量导向的词汇来引导模型。另外,有意思的是,v6对“--style raw”参数的反应可能更敏感,这个参数通常会减少模型的默认艺术化修饰,产出更写实、细节更原始的结果,值得一试。

提升画面连贯性的提示词撰写策略

为了获得连贯的系列图像,提示词的结构很重要。建议将稳定的元素(角色描述、核心环境、整体风格)放在提示词的前部或使用更重的权重(比如用双冒号::强调)。对于变化元素(动作、表情、视角),可以放在后面或单独通过变化参数控制。在生成多张图时,使用相同的初始“种子”值(--seed)仍然是保证风格一致性的有效基础。更重要的是,现在你可以更信任模型去理解一个复杂的场景描述,不必再像过去那样拆解得过细。

新版本参数与设置的最佳实践

v6引入或优化了一些参数。除了熟悉的“--ar”(纵横比)、“--chaos”(混沌值)之外,要多关注“--stylize”(风格化)参数。在v6中,这个参数对画面的影响可能发生了变化,较低的值可能更严格遵循你的提示词,较高的值则赋予模型更多艺术发挥空间,需要根据你的需求调整。另外,由于模型能力增强,有时候简单的提示词反而能产生惊喜,不必总是堆砌词汇。多实验,找到新版本下提示词复杂度与出图效果之间的新平衡点,是关键。

行业影响与未来展望

Midjourney v6的发布,无疑在已经白热化的AI图像生成领域又投下了一颗石子,它的涟漪正在扩散。

AI图像生成领域的竞争格局变化

v6在细节和连贯性上设立的新的标杆,无疑会给其他竞争对手如DALL-E 3、Stable Diffusion等带来压力,推动整个行业向更高阶的“理解与创造”迈进。竞争的重点,可能会从单纯的“画质竞赛”,部分转向“逻辑与可控性竞赛”。这对于我们用户来说是好事,意味着我们将更快地用上更聪明、更懂人心的工具。

v6版本对创意工作流程的重新定义

它正在将AI从“灵感激发器”和“素材生成器”,推向“初级执行伙伴”的角色。更多创意工作者会开始思考:哪些重复性的、基于规则的细节绘制可以交给AI?如何将AI生成的高质量素材无缝整合到自己的专业流程中?创意工作的核心,可能会进一步向“前期概念定义”和“后期审美决策”两端集中。这要求创作者不仅要有审美和创意,还要具备驾驭和引导AI的新技能。

Midjourney未来技术发展方向预测

展望未来,Midjourney可能会在几个方向继续深化。一是更强的动态和3D理解,或许未来我们能通过描述直接生成一段连贯的短视频或简单3D模型。二是更高的可控性和编辑能力,比如指哪改哪的精准编辑、对画面元素的解耦与独立控制。三是与其他工具的深度集成,形成更流畅的创作管线。当然,版权和伦理问题也必将伴随技术进步得到更多关注和解决。无论如何,v6让我们看到,AI与人类协同创作的故事,才刚刚翻开精彩的下一章。

回过头看,Midjourney v6的这次更新,确实不是一次简单的“升级”,而是一次有方向的“进化”。它精准地瞄准了创作中最需要智慧和理解力的部分——细节的质感与逻辑的自治。作为使用者,我们获得的不仅是一个更强大的工具,更是一面镜子,映照出人类对“逼真”与“合理”的永恒追求。它挑战我们使用更精准的语言去描述想象,也让我们重新思考创意过程中,哪些是机器可以效劳的“技艺”,哪些是人类不可替代的“灵光”。未来的创作,或许将是人类意图与AI执行力之间一场愈发默契的共舞。而v6,无疑为这场共舞搭建了一个更宽广、更稳固的舞台。

常见问题

Midjourney v6相比v5主要提升了哪些方面?

Midjourney v6的核心提升在于图像细节的丰富度和画面整体的逻辑连贯性。具体表现为材质纹理更逼真(如毛衣的针织感),以及复杂场景中物体空间关系、光影逻辑的一致性显著增强。

v6版本在图像细节上有什么具体改进?

v6版本实现了从“形状模拟”到“材质表达”的跨越。生成的图像经得起放大细看,能更准确地表现不同材料的特有质感,例如毛线的蓬松、皮革的纹路等细微特征,避免了以往光滑失真的塑料感。

画面“逻辑连贯性”提升指的是什么?

指的是AI对复杂描述的整体理解能力增强。例如,在生成包含多元素、特定环境与光影的场景时,v6能更好地处理各元素之间的合理空间布局、透视关系以及统一的光影效果,使画面整体更可信、更“讲得通”。

Midjourney v6更新对普通用户有什么实际影响?

对用户而言,最直接的影响是能用更自然、更接近日常口语的描述词,生成出细节更精致、场景逻辑更合理的图像。这降低了获得高质量结果的门槛,提升了创作效率和成品的可用性。